Zookeeper部署

1、概述

Zookeeper是一个开源的分布式的,为分布式框架提供协调服务的Apache项目。

工作机制:

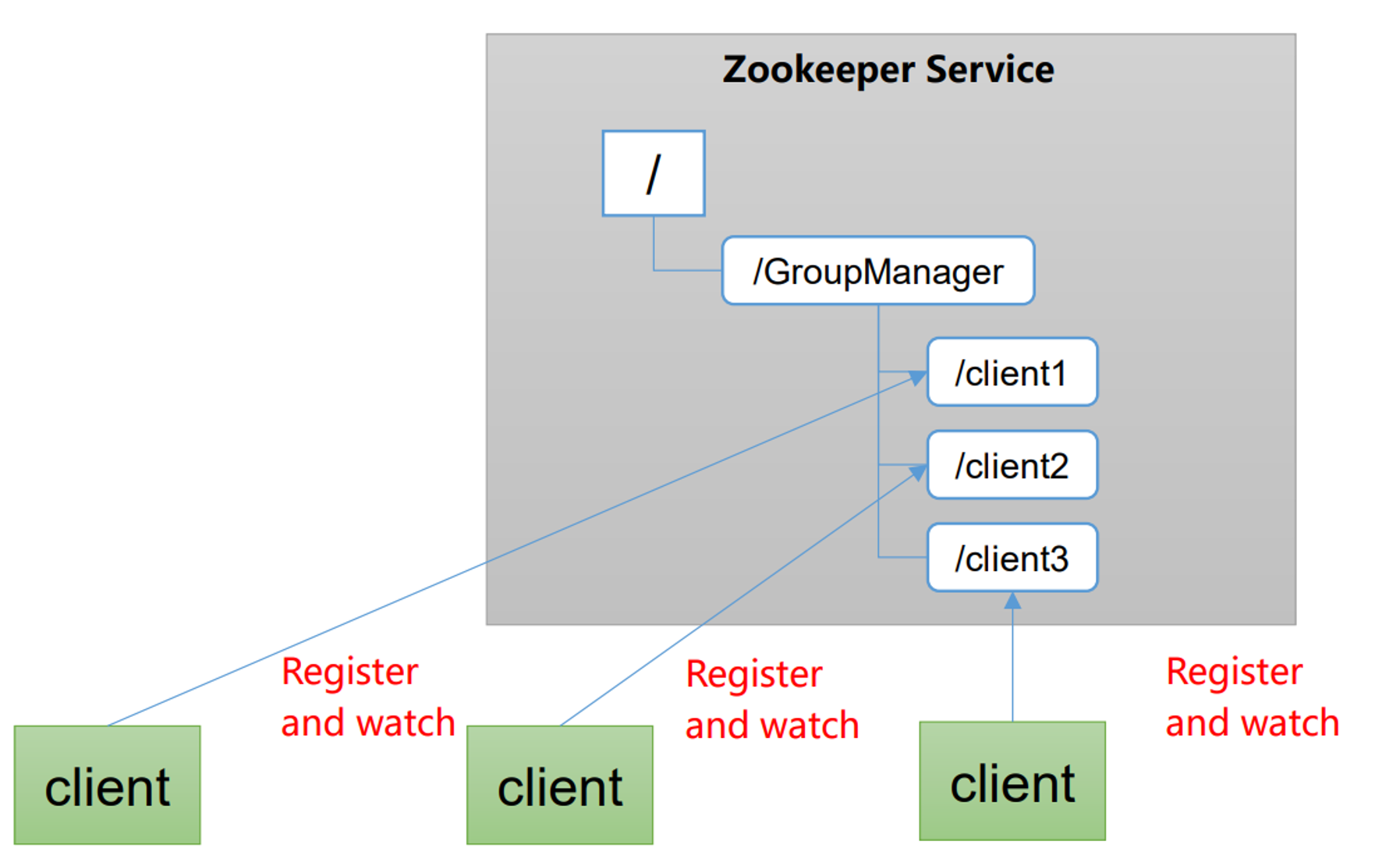

- Zookeeper从设计模式角度来理解,是一个基于观察者模式设计的分布式服务管理框架,它负责存储和管理大家都关心的数据,然后接受观察者的注册,一旦这些数据的状态发生变化,Zookeeper就将负责通知已经在Zookeeper上注册的那些观察者做出相应的反应。

{% asset_img 1632208665503.png 1632208665503 %}

特点:

![]()

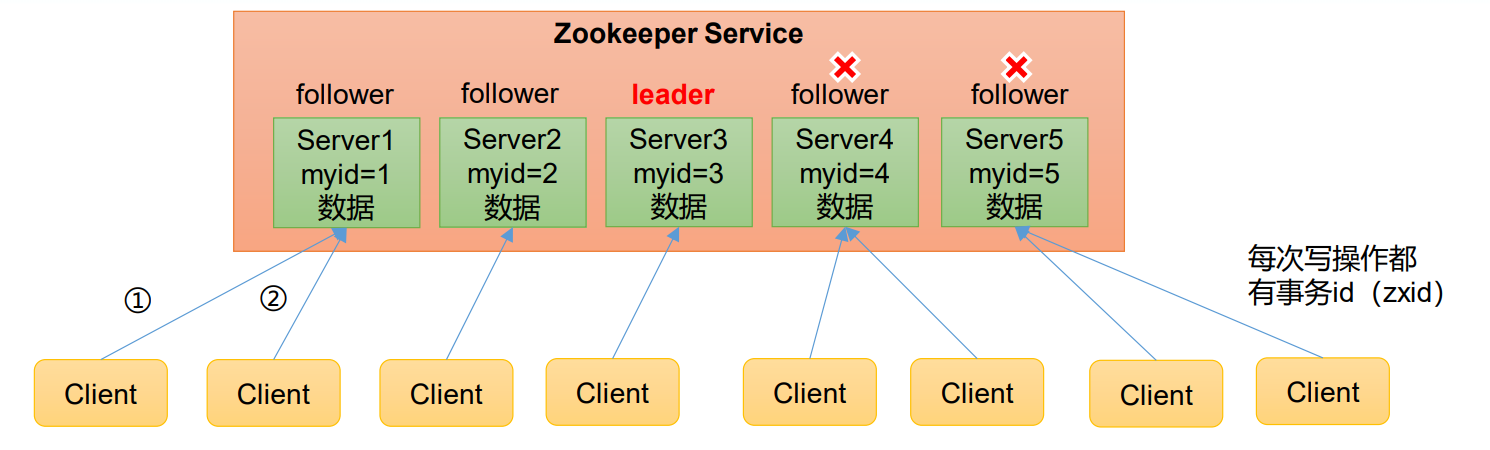

- Zookeeper:一个领导者(Leader),多个跟随者(Follower)组成的集群。

- 集群中只要有半数以上节点存活,Zookeeper集群就能正常服务。所以Zookeeper适合安装奇数台服务器。

- 全局数据一致:每个Server保存一份相同的数据副本,Client无论连接到哪个Server,数据都是一致的。

- 更新请求顺序执行,来自同一个Client的更新请求按其发送顺序依次执行。

- 数据更新原子性,一次数据更新要么成功,要么失败。

- 实时性,在一定时间范围内,Client能读到最新数据。

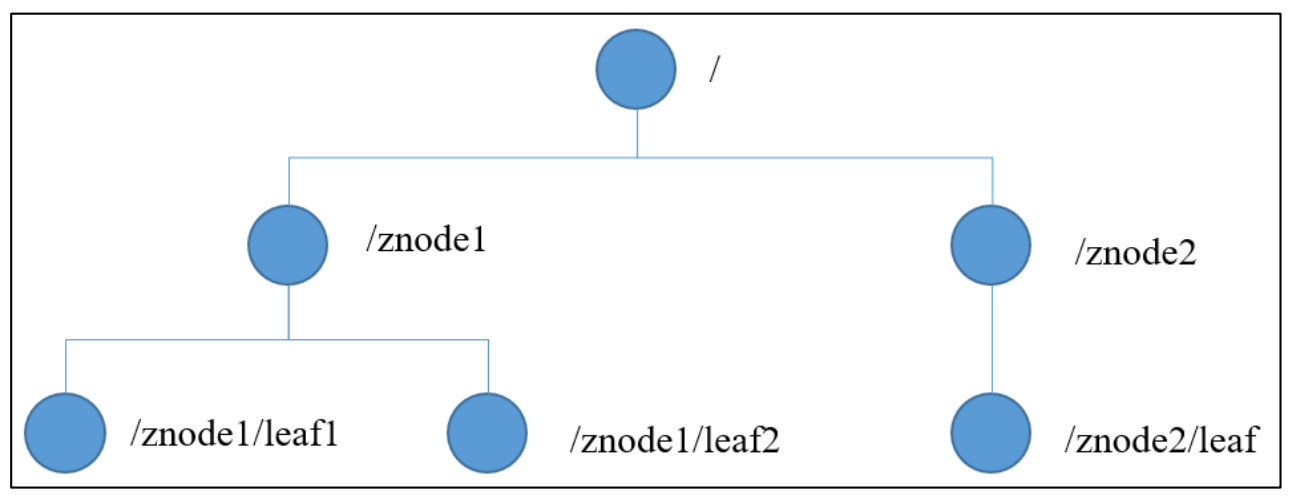

数据结构:

ZooKeeper数据模型的结构与Unix文件系统很类似,整体上可以看作是一棵树,每个节点称做一个ZNode。每一个ZNode默认能够存储1MB的数据,每个ZNode都可以通过其路径唯一标识。

![]()

应用场景:

提供的服务包括:统一命名服务、统一配置管理、统一集群管理、服务器节点动态上下 线、软负载均衡等。

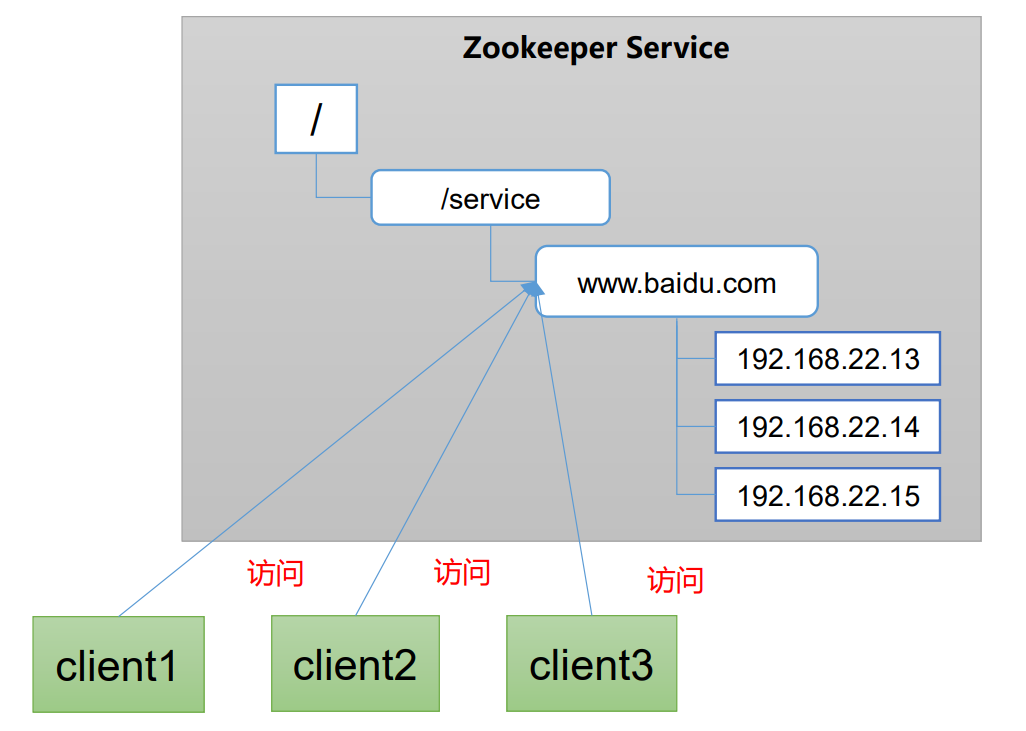

①统一命名服务。 在分布式环境下,经常需要对应用/服 务进行统一命名,便于识别。例如:IP不容易记住,而域名容易记住。

![1632209246320]()

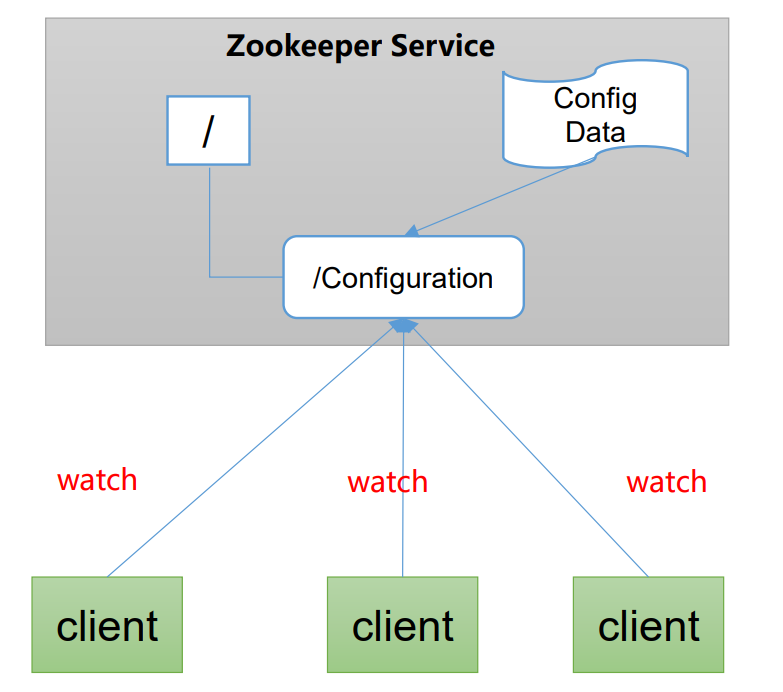

②统一配置管理。

- 分布式环境下,配置文件同步非常常见。

- 一般要求一个集群中,所有节点的配置信息是一致的,比如 Kafka 集群。

- 对配置文件修改后,希望能够快速同步到各个节点上。

- 配置管理可交由ZooKeeper实现。

- 可将配置信息写入ZooKeeper上的一个Znode。

- 各个客户端服务器监听这个Znode。

- 一旦Znode中的数据被修改,ZooKeeper将通知各个客户端服务器。

![1632209823959]()

- 分布式环境下,配置文件同步非常常见。

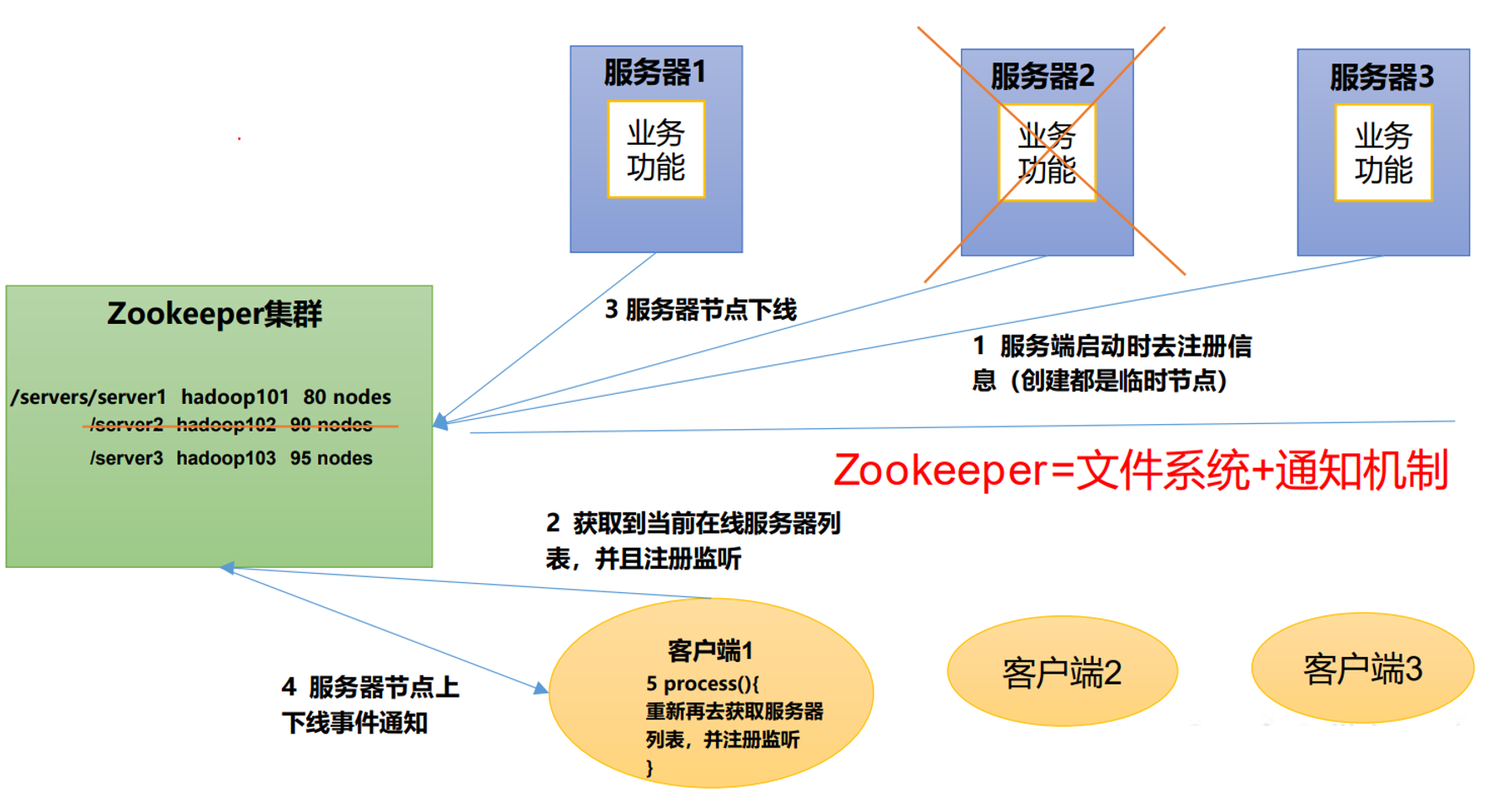

③统一集群管理。

- 分布式环境中,实时掌握每个节点的状态是必要的,可根据节点实时状态做出一些调整。

- ZooKeeper可以实现实时监控节点状态变化。

- 可将节点信息写入ZooKeeper上的一个ZNode。

- 监听这个ZNode可获取它的实时状态变化。

![1632210372870]()

④服务器动态上下线。 客户端能实时洞察到服务 器上下线的变化。

![]()

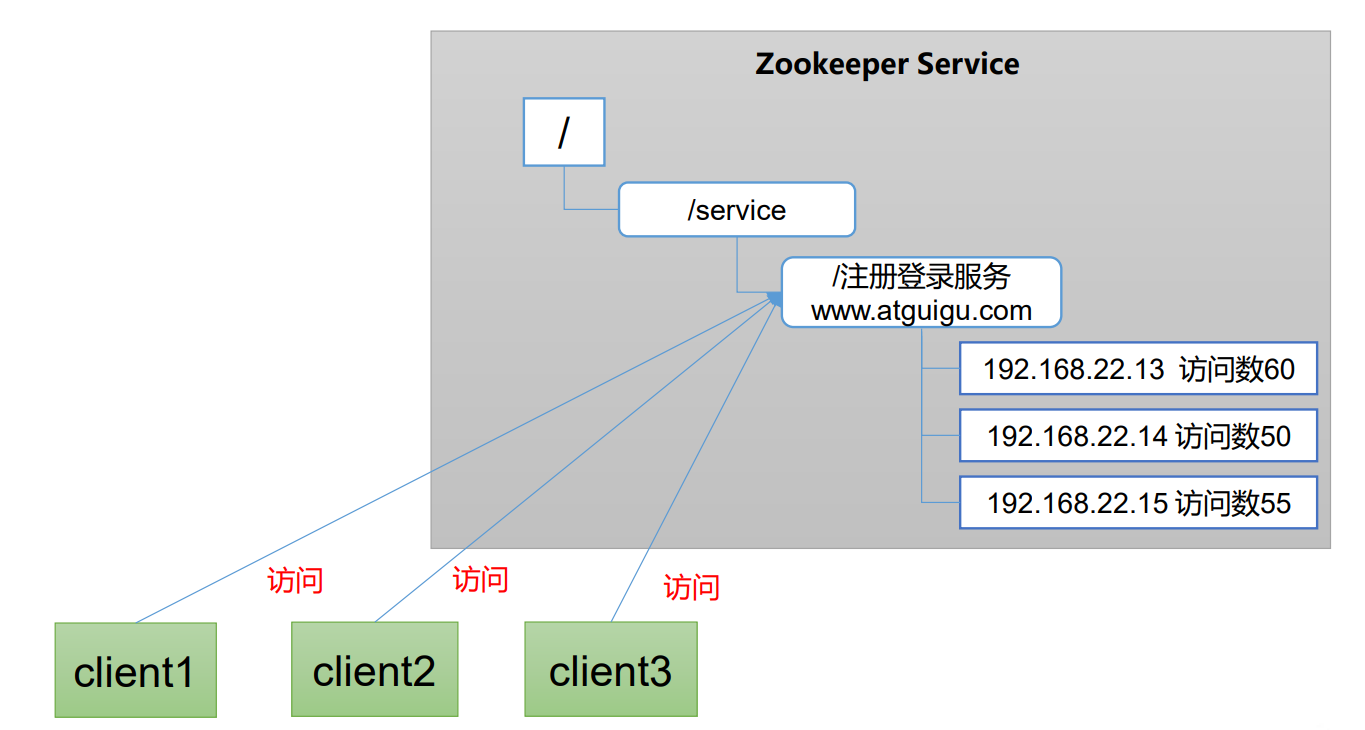

⑤软负载均衡。 在Zookeeper中记录每台服务器的访问数,让访问数最少的服务器去处理最新的客户端请求

![]()

2、部署

2.1 docker单机部署

1 | [root@iz2zecc4mo4hoc75p0frn8z ~]# docker pull zookeeper:3.5.7 |

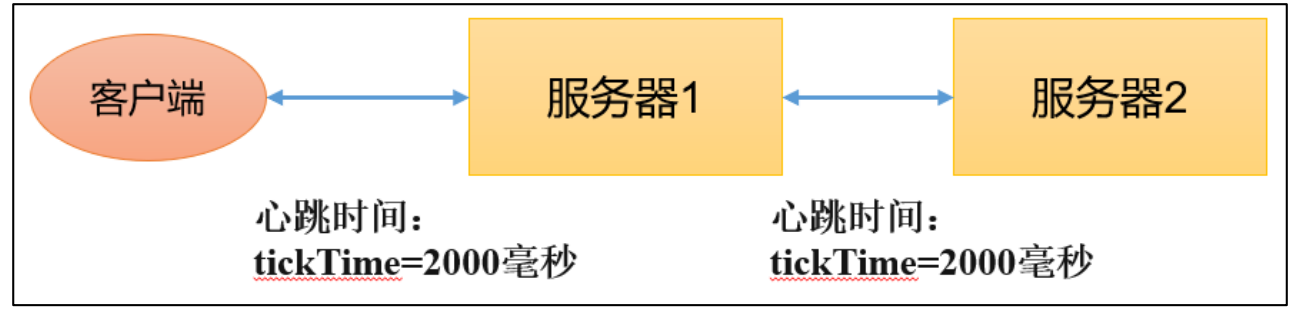

配置文件zoo.cfg说明:

①tickTime=2000:通信心跳时间,Zookeeper服务器与客户端心跳时间,单位毫秒。

![]()

②initLimit=10:LF初始通信时限。

![]()

- Leader和Follower初始连接时能容忍的最多心跳数(tickTime的数量)

③syncLimit=5:LF同步通信时限。

![]()

- Leader和Follower之间通信时间如果超过syncLimit * tickTime,Leader认为Follwer死掉,从服务器列表中删除Follwer。

④dataDir=/tmp/zookeeper:保存Zookeeper中的数据。(默认的tmp目录,容易被Linux系统定期删除,所以一般不用默认的tmp目录)

⑤clientPort=2181:客户端连接端口,通常不做修改。

2.2 docker集群部署

本案例是搭建一主二从的Zookeeper集群,所以要启动三个Zookeeper容器,由于这里使用桥接模式,所以需要虚拟一个自定义bridge网络,然后创建容器的时候指定ip,这样才能使得三个容器能够相互通信,具体有关docker网络模式的原理可参考:https://perfectcode.top/2021/04/23/docker%E7%BD%91%E7%BB%9C/

①在本地创建目录。

1

2

3

4

5

6

7

8

9[root@iz2zecc4mo4hoc75p0frn8z ~]# mkdir /usr/local/zookeeper-cluster

[root@iz2zecc4mo4hoc75p0frn8z ~]# mkdir /usr/local/zookeeper-cluster/node1

[root@iz2zecc4mo4hoc75p0frn8z ~]# mkdir /usr/local/zookeeper-cluster/node2

[root@iz2zecc4mo4hoc75p0frn8z ~]# mkdir /usr/local/zookeeper-cluster/node3

[root@iz2zecc4mo4hoc75p0frn8z ~]# ll /usr/local/zookeeper-cluster/

total 12

drwxr-xr-x 2 root root 4096 Sep 21 20:40 node1

drwxr-xr-x 2 root root 4096 Sep 21 20:40 node2

drwxr-xr-x 2 root root 4096 Sep 21 20:40 node3②创建docker自定义bridge网络。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39[root@iz2zecc4mo4hoc75p0frn8z ~]# docker network create --driver bridge --subnet=172.18.0.0/16 --gateway=172.18.0.1 zoonet

37297b2c4502835e622c4f9748b65c9bc5678cb67199d237c03c98a62670aca2

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker network ls

NETWORK ID NAME DRIVER SCOPE

b57513a4a23c bridge bridge local

5bbd0c03d622 host host local

463914162c9f none null local

37297b2c4502 zoonet bridge local

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker network inspect 37297b2c4502

[

{

"Name": "zoonet",

"Id": "37297b2c4502835e622c4f9748b65c9bc5678cb67199d237c03c98a62670aca2",

"Created": "2021-09-21T20:35:14.7142266+08:00",

"Scope": "local",

"Driver": "bridge",

"EnableIPv6": false,

"IPAM": {

"Driver": "default",

"Options": {},

"Config": [

{

"Subnet": "172.18.0.0/16",

"Gateway": "172.18.0.1"

}

]

},

"Internal": false,

"Attachable": false,

"Ingress": false,

"ConfigFrom": {

"Network": ""

},

"ConfigOnly": false,

"Containers": {},

"Options": {},

"Labels": {}

}

]③创建三个Zookeeper容器,并使用刚创建的自定义网络zoonet。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15[root@iz2zecc4mo4hoc75p0frn8z ~]# docker images

REPOSITORY TAG IMAGE ID CREATED SIZE

zookeeper 3.5.7 6bd990489b09 16 months ago 245MB

java 8 d23bdf5b1b1b 4 years ago 643MB

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker run -d -p 2181:2181 --name zookeeper_node1 --privileged --network zoonet --ip 172.18.0.2 -v /usr/local/zookeeper-cluster/node1/volumes/data:/data -v /usr/local/zookeeper-cluster/node1/volumes/datalog:/datalog -v /usr/local/zookeeper-cluster/node1/volumes/logs:/logs -e ZOO_MY_ID=1 -e "ZOO_SERVERS=server.1=172.18.0.2:2888:3888;2181 server.2=172.18.0.3:2888:3888;2181 server.3=172.18.0.4:2888:3888;2181" 6bd990489b09

df11b76dc4fed4c254f29ed575cf42625950e4d36faf25e11e7db366d91016bd

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker run -d -p 2182:2181 --name zookeeper_node2 --privileged --network zoonet --ip 172.18.0.3 -v /usr/local/zookeeper-cluster/node2/volumes/data:/data -v /usr/local/zookeeper-cluster/node2/volumes/datalog:/datalog -v /usr/local/zookeeper-cluster/node2/volumes/logs:/logs -e ZOO_MY_ID=2 -e "ZOO_SERVERS=server.1=172.18.0.2:2888:3888;2181 server.2=172.18.0.3:2888:3888;2181 server.3=172.18.0.4:2888:3888;2181" 6bd990489b09

0b443ec0cb28fd1497ebfc1f3cd7642d8f174dbde8e3ab4dab9963b37dd2d543

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker run -d -p 2183:2181 --name zookeeper_node3 --privileged --network zoonet --ip 172.18.0.4 -v /usr/local/zookeeper-cluster/node3/volumes/data:/data -v /usr/local/zookeeper-cluster/node3/volumes/datalog:/datalog -v /usr/local/zookeeper-cluster/node3/volumes/logs:/logs -e ZOO_MY_ID=3 -e "ZOO_SERVERS=server.1=172.18.0.2:2888:3888;2181 server.2=172.18.0.3:2888:3888;2181 server.3=172.18.0.4:2888:3888;2181" 6bd990489b09

04115c6f70d2e6ac683f81554d16c89427d17f5dfb39340ebee43dc7cc825f20

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

04115c6f70d2 6bd990489b09 "/docker-entrypoint.…" 4 seconds ago Up 3 seconds 2888/tcp, 3888/tcp, 8080/tcp, 0.0.0.0:2183->2181/tcp zookeeper_node3

0b443ec0cb28 6bd990489b09 "/docker-entrypoint.…" About a minute ago Up About a minute 2888/tcp, 3888/tcp, 8080/tcp, 0.0.0.0:2182->2181/tcp zookeeper_node2

df11b76dc4fe 6bd990489b09 "/docker-entrypoint.…" 4 minutes ago Up 4 minutes 2888/tcp, 3888/tcp, 0.0.0.0:2181->2181/tcp, 8080/tcp zookeeper_node1- 配置参数解读(server.A=B:C:D):

- A是一个数字,表示这个是第几号服务器。

- 集群模式下配置一个文件myid,这个文件在dataDir目录下,这个文件里面有一个数据就是 A的值,Zookeeper启动时读取此文件,拿到里面的数据与zoo.cfg里面的配置信息比较从而判断到底是哪个server。

- B是这个服务器的地址。

- C是这个服务器Follower与集群中的Leader服务器交换信息的端口。

- D是万一集群中的Leader服务器挂了,需要一个端口来重新进行选举,选出一个新的Leader,而这个端口就是用来执行选举时服务器相互通信的端口。

- A是一个数字,表示这个是第几号服务器。

- 配置参数解读(server.A=B:C:D):

④进入容器内部验证主从是否搭建成功。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25[root@iz2zecc4mo4hoc75p0frn8z ~]# docker exec -it zookeeper_node1 /bin/bash

root@df11b76dc4fe:/apache-zookeeper-3.5.7-bin# ./bin/zkServer.sh status

ZooKeeper JMX enabled by default

Using config: /conf/zoo.cfg

Client port found: 2181. Client address: localhost.

Mode: follower # 从机

root@df11b76dc4fe:/apache-zookeeper-3.5.7-bin# exit

exit

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker exec -it zookeeper_node2 /bin/bash

root@0b443ec0cb28:/apache-zookeeper-3.5.7-bin# ./bin/zkServer.sh status

ZooKeeper JMX enabled by default

Using config: /conf/zoo.cfg

Client port found: 2181. Client address: localhost.

Mode: leader # 主机

root@0b443ec0cb28:/apache-zookeeper-3.5.7-bin# exit

exit

[root@iz2zecc4mo4hoc75p0frn8z ~]# docker exec -it zookeeper_node3 /bin/bash

root@04115c6f70d2:/apache-zookeeper-3.5.7-bin# ./bin/zkServer.sh status

ZooKeeper JMX enabled by default

Using config: /conf/zoo.cfg

Client port found: 2181. Client address: localhost.

Mode: follower # 从机

root@04115c6f70d2:/apache-zookeeper-3.5.7-bin# exit

exit

[root@iz2zecc4mo4hoc75p0frn8z ~]#